週間AIニュース(2026年03月09日週)- Pentagon契約問題とAI軍事利用の分岐点

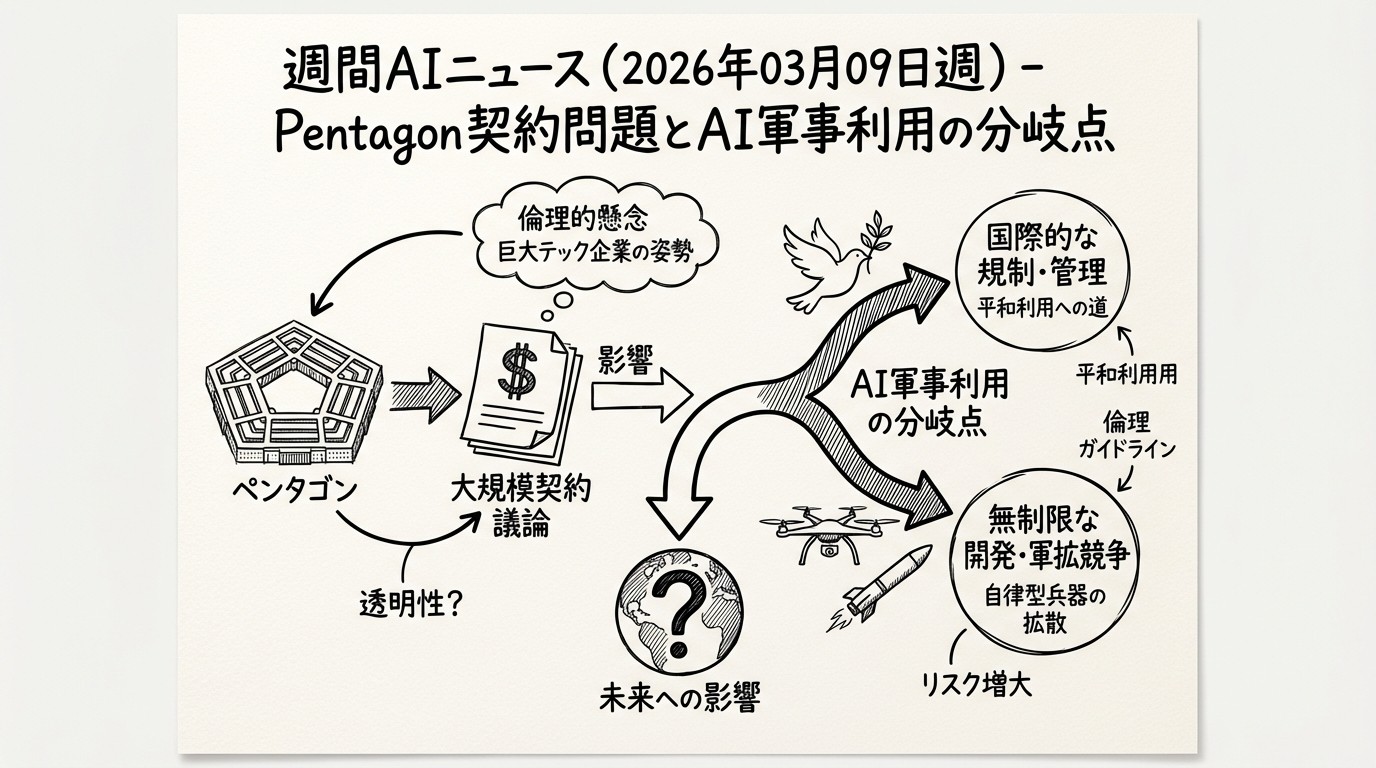

2026年3月2日(月)〜9日(日)の週は、AI業界において「軍事利用」という根本的な倫理問題が前面に出た歴史的な週となりました。OpenAIのPentagon(米国防総省)契約に対する消費者・従業員からの激しい反発、AnthropicのPentagon supply-chain risk指定とその法的対応など、AI企業と軍事・政府機関との関係が大きく揺れ動きました。一方で、技術面ではOpenAI GPT-5.4のリリース、Claude AIによるFirefox脆弱性の大量発見など、AIの能力向上を示すニュースも相次ぎました。本記事では、この激動の週に起きた主要なAI関連ニュースを網羅的に解説します。

今週のハイライト

1. OpenAI Pentagon契約への批判殺到 - ChatGPTアンインストール295%急増

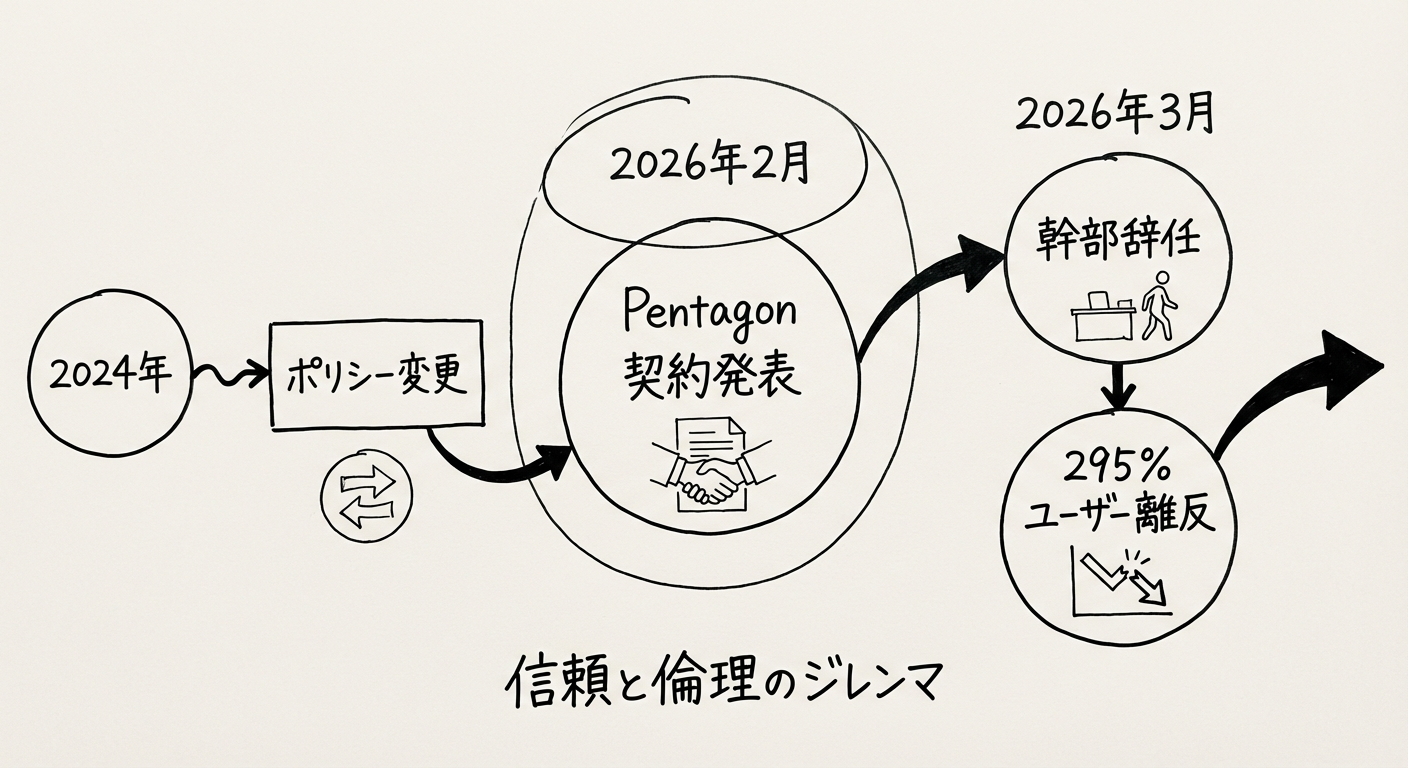

OpenAIが2月下旬に発表したPentagon(米国防総省)との正式契約に対し、3月第1週は激しい批判が集中しました。データ分析会社の調査によると、契約発表後のChatGPTアプリのアンインストール数が通常期間比で295%急増したことが明らかになりました。

この消費者離反の背景には、OpenAIがかつて「軍事利用禁止」をポリシーとして掲げていた経緯があります。2024年1月にこのポリシーを密かに削除し、2026年2月にPentagon契約を発表したことで、「約束を破った」という批判が噴出しました。Wiredの調査報道では、Pentagonが正式契約前からMicrosoft Azure経由でOpenAIの技術をテストしていた可能性も指摘されています。

図1: OpenAI軍事ポリシー変更からPentagon契約までの経緯とユーザー反応(報道を基に作成)

幹部の辞任

3月7日には、OpenAIのハードウェア部門幹部Caitlin Kalinowski氏がPentagon契約への抗議として辞任したことが報じられました。Kalinowski氏はMeta(旧Facebook)でAR/VRデバイス開発を率いた実績を持つ人物で、2025年にOpenAIに参画していました。彼女の辞任は、社内にも軍事契約に対する強い反発があることを示しています。

Anthropic CEOの痛烈な批判

Anthropicの共同創業者兼CEOであるDario Amodei氏は、TechCrunchの取材に対し、OpenAIの軍事契約に関する説明を「straight up lies(完全な嘘)」と強い言葉で批判しました。Amodei氏自身もOpenAIの元幹部であり、両社のAI安全に対するアプローチの違いが改めて浮き彫りになりました。

日本企業への示唆

このユーザー離反は、AI企業の倫理的姿勢が消費者の選択に直接影響することを示しています。日本企業がAIベンダーを選定する際も、技術性能だけでなく、そのベンダーの倫理方針・政府契約状況がレピュテーションリスクとなり得ることを認識すべきです。

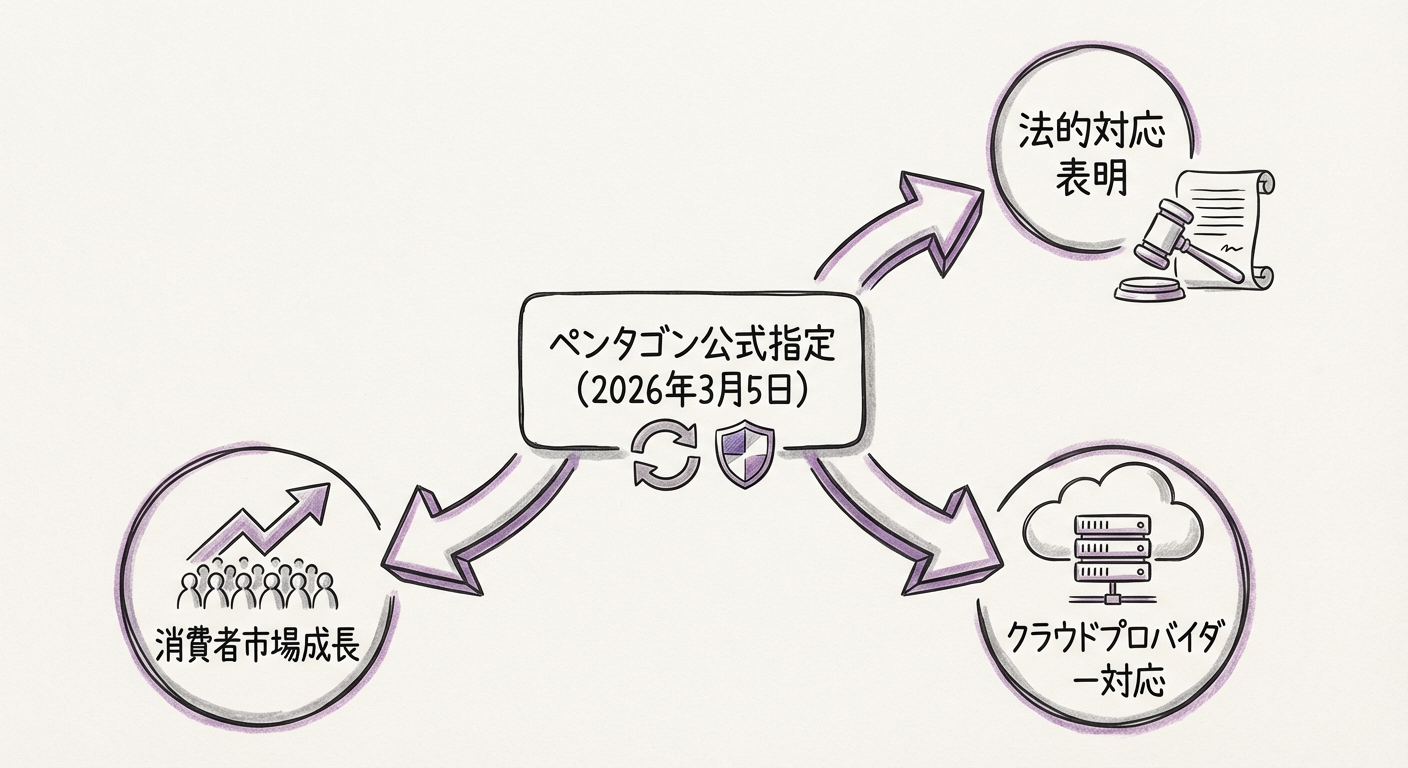

2. Anthropic、Pentagon Supply-Chain Riskに指定 - 法的対応を表明

3月5日、PentagonはAnthropicを正式に「supply-chain risk(サプライチェーンリスク)」企業として指定しました。この指定は、Anthropicの製品・サービスを連邦政府機関が調達する際に追加の審査や制限が課されることを意味します。

指定の背景

報道によると、この指定の理由として、Anthropicの投資家構成(Googleや複数の国際的なVCファンドが含まれる)や、同社が軍事利用に対して慎重な姿勢を示してきたことが挙げられています。Pentagonは公式にはコメントを控えていますが、業界関係者の間では「軍事協力に消極的なAI企業への警告」との見方が広がっています。

Anthropicの対応

3月6日、AnthropicはPentagonの指定に対し法的に異議を申し立てる方針を発表しました。同社の声明では「この指定は不当であり、Anthropicが安全で責任あるAI開発に取り組んできた実績を無視している」と主張しています。

図2: Anthropic supply-chain risk指定の影響範囲と対応(公開情報を基に作成)

クラウドプロバイダーの対応

Microsoft、Google、AWSの3社は、Anthropicの指定に関する声明を発表し、「非国防分野の顧客に対するClaude AIサービスの提供は継続する」と明言しました。これにより、民間企業がClaudeを利用することへの直接的な影響は限定的と見られています。

消費者市場での追い風

皮肉なことに、Pentagon関連のニュースはAnthropicの消費者向けサービスには追い風となっています。OpenAIのPentagon契約に反発したユーザーの一部がClaudeに移行していると報じられており、Anthropicの消費者向け利用は成長を続けています。

3. OpenAI GPT-5.4リリース - Pro/Thinkingの2バリアント展開

技術面では、OpenAIが3月5日にGPT-5.4を正式リリースしました。GPT-5.4は「Pro」と「Thinking」の2つのバリアントで提供され、それぞれ異なるユースケースに最適化されています。

GPT-5.4 Proの特徴

GPT-5.4 Proは、GPT-5.3 Instantの高速応答性能を維持しながら、マルチモーダル(画像・音声・テキスト)処理能力を大幅に強化したモデルです。特にビジネスドキュメントの分析、プレゼンテーション資料の生成、複雑なデータの可視化などのタスクで性能向上が報告されています。

GPT-5.4 Thinkingの特徴

GPT-5.4 Thinkingは、o3-miniで導入された「推論努力レベル」機能をさらに発展させ、複雑な問題に対して段階的な思考プロセスを可視化できるモデルです。数学、科学、法律、医療などの専門分野でのベンチマークでGPT-5.3を大きく上回る性能を示しています。

GPT-5.3 Instant - 感情的応答の改善

3月3日には、GPT-5.3 Instantのアップデートも発表されました。このアップデートでは、ユーザーから批判の多かった「見下したような感情的応答」を改善し、ユーザーの感情に共感しながらも適切な距離感を保った応答を生成するよう調整されています。

4. Claude AI、Firefoxで22件のセキュリティ脆弱性を発見

3月6日、Anthropicは自社のClaude AIがMozilla Firefoxのソースコードを2週間分析し、22件のセキュリティ脆弱性を発見したと発表しました。これは、AIによる自動セキュリティ監査の実用性を示す重要な事例となりました。

発見された脆弱性の内容

公開情報によると、発見された22件の脆弱性には、メモリ安全性の問題、クロスサイトスクリプティング(XSS)のリスク、サンドボックスバイパスの可能性などが含まれていました。Mozillaのセキュリティチームは既にこれらの脆弱性の修正に着手しており、Claude AIのコード分析能力を高く評価しています。

AIセキュリティ監査の可能性

この成果は、大規模なコードベースのセキュリティ監査にAIを活用する可能性を示しています。従来、人間のセキュリティ専門家が数ヶ月かけて行っていた監査作業を、AIが数週間で補完できることが実証されました。ただし、Anthropicは「AIは人間の専門家を代替するものではなく、効率化ツールとして機能する」と強調しています。

日本のソフトウェア開発への影響

日本企業においても、セキュリティ人材不足は深刻な課題です。AIによるコード監査の活用は、特にレガシーシステムのセキュリティ強化や、オープンソースライブラリの脆弱性チェックにおいて有効な選択肢となる可能性があります。

5. NVIDIA Jensen Huang氏、OpenAI・Anthropicとの関係見直しを示唆

3月5日、NVIDIAのCEO Jensen Huang氏は投資家向けの説明会で、OpenAIおよびAnthropicとの関係を「見直している」と発言し、業界に波紋を広げました。

発言の背景

Huang氏の発言は、AI業界のパワーバランスの変化を示唆しています。これまでNVIDIAは主要なAI企業に対してGPUを優先供給し、場合によっては資本参加も行ってきました。しかし、AI企業間の競争激化、軍事契約をめぐる論争、そして中国AI企業(DeepSeekなど)の台頭により、NVIDIAの立ち位置が複雑化しています。

明確な説明を避ける姿勢

注目すべきは、Huang氏がこの関係見直しの具体的な理由を明確に説明しなかった点です。TechCrunchは「この曖昧さが逆に多くの疑問を呼んでいる」と報じており、AI半導体市場における微妙な力学が垣間見えます。

チップ輸出規制の影響

同日、米国政府が新たなAIチップ輸出規制を検討しているとの報道もあり、NVIDIAの国際ビジネスへの影響が懸念されています。これらの規制が実施されれば、NVIDIAは主要AI企業との関係だけでなく、グローバルな販売戦略も大幅に見直す必要に迫られる可能性があります。

今週のその他のニュース

3月4日、GoogleはGemini Canvasの「AI Mode」を米国の全ユーザーに展開しました。Gemini CanvasはGoogle検索にAI機能を統合し、検索結果を基にしたクリエイティブなコンテンツ生成を可能にする機能です。これにより、ユーザーは検索と同時に文章作成、画像編集、コード生成などのタスクを実行できるようになります。

3月4日には、Google Geminiチャットボットに関する訴訟も報じられました。ある父親が、Geminiが息子を「致命的な妄想」に導いたとしてGoogleを提訴しています。この訴訟は、AIチャットボットのメンタルヘルスへの影響に関する法的責任問題を提起しています。

3月6日、Google DeepMindは新たなコマンドラインツールを発表し、OpenClawとGoogle Workspaceデータの連携を可能にしました。これにより、エンタープライズユーザーはAI機能をより柔軟に業務ツールと統合できるようになります。

AWSは3月5日、医療分野に特化したAIエージェントプラットフォームを発表しました。このプラットフォームは、医療機関向けにコンプライアンスとセキュリティを重視した設計となっており、患者データの取り扱いに関する厳格な基準を満たしています。

日本では、3月9日にさくらインターネットが「さくらのAI検定」を創設し、AI学習教材の無料公開を開始しました。生成AI普及に伴うAI人材不足に対応するため、AIサービスの選択や安全な活用能力を持つ人材育成を目指しています。

3月6日、Grammarly(現Superhuman)は、著名作家のAIによるライティングレビュー機能を発表しましたが、許可を得ずに故人を含む作家の名前を使用したことで批判を受けています。AIによる創作支援と著作者の権利の問題が改めて浮き彫りになりました。

AI業界への示唆

2026年3月2日〜9日の動向から、以下の重要なトレンドが読み取れます。

1. 軍事AI利用の「分岐点」

OpenAIのPentagon契約とそれに対する反発、Anthropicのsupply-chain risk指定は、AI業界が軍事利用に関して明確な分岐点に立っていることを示しています。消費者の反応(ChatGPTアンインストール295%増)は、AI企業の倫理的姿勢がビジネスに直接影響することを証明しました。今後、AI企業は軍事・政府契約と消費者市場のバランスを慎重に判断する必要があります。

2. AIセキュリティ監査の実用化

Claude AIによるFirefox脆弱性発見(2週間で22件)は、AIがソフトウェアセキュリティの領域で実用的なツールとなり得ることを示しました。セキュリティ人材不足に悩む企業にとって、AIを活用したコード監査は現実的な選択肢となりつつあります。ただし、AIの発見を検証・対応するための人間の専門家は依然として必要です。

3. AI半導体市場のパワーシフト

NVIDIA Jensen Huang氏の発言と米国チップ輸出規制の動きは、AI半導体市場のパワーバランスが変化しつつあることを示しています。主要AI企業への依存度を下げつつ、地政学的リスクを管理するNVIDIAの動きは、AI業界全体のサプライチェーン構造に影響を与える可能性があります。

4. 消費者主導のAI企業選択

今週の動向で最も注目すべきは、消費者がAI企業の倫理的姿勢に基づいて積極的に選択を行っていることです。OpenAIからの離反とAnthropicへの移行は、技術性能だけでなく企業の価値観がユーザー獲得競争の重要な要素となっていることを示しています。

日本企業への影響

今週の動向は日本企業にとって、以下の優先事項を示しています。

第一に、AIベンダー選定においてレピュテーションリスクを考慮することが重要です。グローバルに展開する企業にとって、使用するAIプロバイダーの軍事契約や政府関係はステークホルダーからの評価に影響する可能性があります。マルチベンダー戦略を採用し、リスク分散を図ることを検討すべきです。

第二に、AIセキュリティ監査の活用検討が挙げられます。Claude AIのFirefox脆弱性発見事例は、日本企業の古いコードベースやオープンソースライブラリのセキュリティ監査にAIを活用する可能性を示しています。セキュリティ人材不足が深刻な日本において、AIを活用した効率化は有効な選択肢です。

第三に、AI人材育成の加速が求められています。さくらインターネットの「さくらのAI検定」のような取り組みは、日本でのAI人材育成が産業界全体で進んでいることを示しています。自社のAI人材育成プログラムの見直しや、こうした外部リソースの活用を検討する良い機会です。

AI COMMONでは、AI技術の最新動向の把握から実装支援まで、企業のAI活用をトータルでサポートしています。 AIベンダー選定、セキュリティ監査へのAI活用、AI人材育成など、AI戦略の策定から実装・運用まで、ぜひお気軽にご相談ください。

関連記事

- 週間AIニュース(2026年03月02日週)- o3-miniリリースとDeepSeek R2の挑戦

- Anthropic vs 米国防総省:AI安全性を巡る企業と政府の歴史的攻防 - 本週のPentagon問題の詳細な背景解説

- 週間AIニュース(2026年02月23日週)

- 米国防総省GenAI.mil:軍用AI基盤の本格稼働と国際安全保障への影響 - Pentagon軍用AI基盤の技術解説

- 2026年AIエージェント完全ガイド:企業導入の実践戦略とユースケース

- 2026年AIガバナンス:責任あるAI開発とグローバル規制への対応戦略

- 生成AIセキュリティ:企業が知るべきリスクと対策

参考文献

本記事は以下のニュースソースおよび公式発表に基づいて作成されました:

-

TechCrunch「ChatGPT uninstalls surged by 295% after DoD deal」(2026年3月3日)

https://techcrunch.com/2026/03/03/chatgpt-uninstalls-surge-dod-deal/ -

TechCrunch「OpenAI hardware exec Caitlin Kalinowski quits in response to Pentagon deal」(2026年3月7日)

https://techcrunch.com/2026/03/07/openai-kalinowski-quits-pentagon/ -

TechCrunch「It's official: The Pentagon has labeled Anthropic a supply-chain risk」(2026年3月5日)

https://techcrunch.com/2026/03/05/pentagon-anthropic-supply-chain-risk/ -

TechCrunch「Anthropic's Claude found 22 vulnerabilities in Firefox over two weeks」(2026年3月6日)

https://techcrunch.com/2026/03/06/claude-firefox-vulnerabilities/ -

TechCrunch「OpenAI launches GPT-5.4 with Pro and Thinking versions」(2026年3月5日)

https://techcrunch.com/2026/03/05/openai-gpt-5-4-release/ -

TechCrunch「Jensen Huang says Nvidia is pulling back from OpenAI and Anthropic」(2026年3月5日)

https://techcrunch.com/2026/03/05/nvidia-openai-anthropic-pullback/ -

Wired「OpenAI Had Banned Military Use. The Pentagon Tested Its Models Through Microsoft Anyway」(2026年3月5日)

https://www.wired.com/story/openai-pentagon-microsoft-testing/ -

ITmedia AI+「さくらインターネット『さくらのAI検定』を創設」(2026年3月9日)

https://www.itmedia.co.jp/enterprise/articles/2603/08/news016.html -

TechCrunch「Google Search rolls out Gemini's Canvas in AI Mode to all US users」(2026年3月4日)

https://techcrunch.com/2026/03/04/google-gemini-canvas-us/

📢この記事をシェアしませんか?

おすすめの投稿:

🔥 AI軍事利用が転換点に!OpenAI Pentagon契約で295%アンインストール急増、Anthropicはsupply-chain risk指定。GPT-5.4リリース、ClaudeがFirefox脆弱性22件発見など注目ニュース満載

引用しやすいフレーズ:

“OpenAI Pentagon契約後、ChatGPTアンインストールが295%急増 - 軍事AI利用への消費者反発が顕在化”

“Anthropic CEOがOpenAIの軍事契約説明を「straight up lies」と批判 - AI業界の分断が深まる”

“Claude AI、Firefoxで22件のセキュリティ脆弱性を2週間で発見 - AIによる自動セキュリティ監査の可能性”

“NVIDIA Jensen Huang氏、OpenAI・Anthropicとの関係見直しを示唆 - AI企業間パワーバランスに変化”

“Pentagon、Anthropicをsupply-chain riskに指定 - 政府AI調達の方向性に影響”