Anthropic vs 米国防総省:AI安全性を巡る企業と政府の歴史的攻防

2026年2月27日から28日にかけて、AI業界の歴史に刻まれる出来事が起きました。AIスタートアップのAnthropicが米国防総省(Pentagon)の要求を拒否し、トランプ大統領がAnthropicを連邦政府から排除する命令を下したのです。この対立は、AI企業が政府の要求にどこまで応じるべきかという根本的な問いを突きつけています。

対立の経緯

国防総省の要求

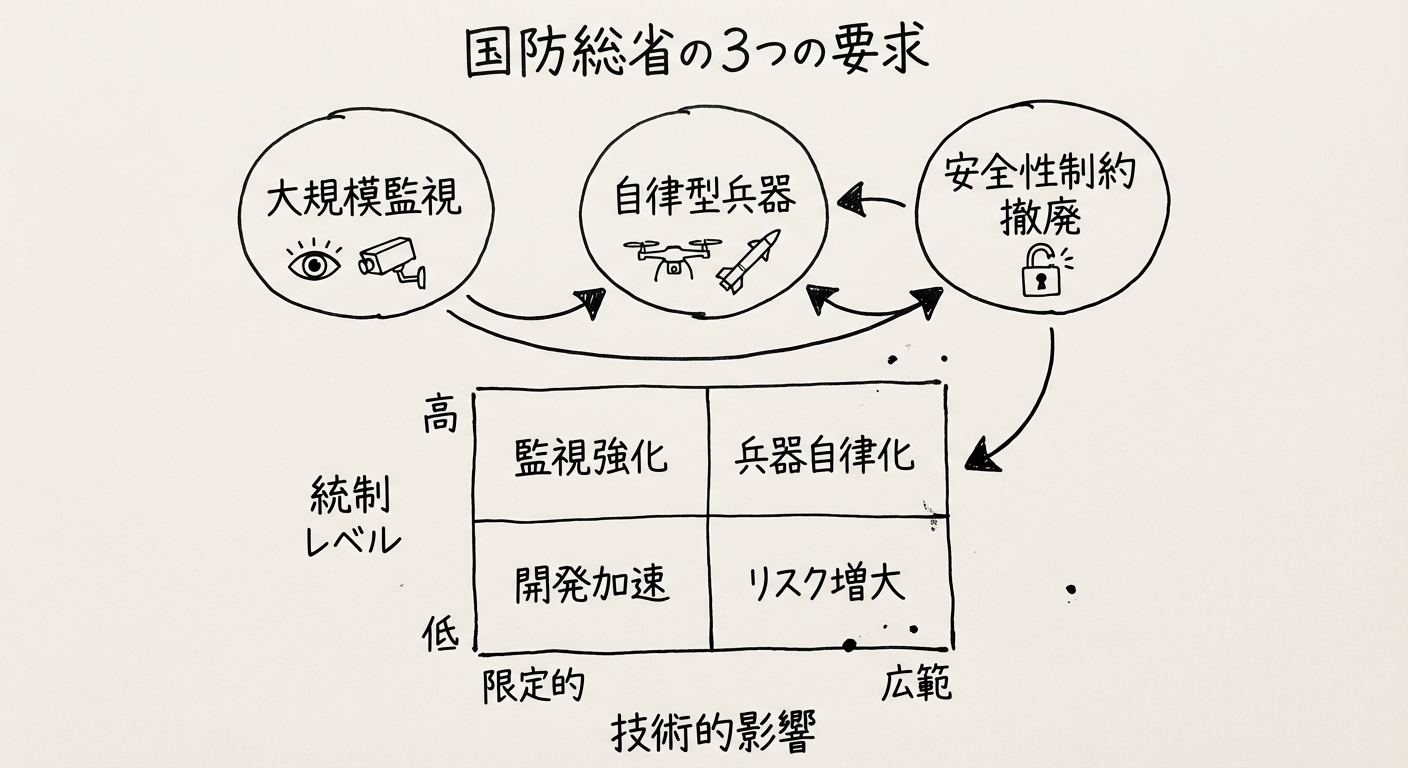

2026年2月中旬、米国防総省はAnthropicに対し、軍事利用に関する新たな契約条件を提示しました。その内容は以下の3点でした:

- 大規模監視システムへの転用許可:国民や外国人を対象とした監視活動にClaudeを使用できるようにすること

- 完全自律型兵器への統合:人間の承認なしに標的を選択・攻撃できる兵器システムへのAI統合

- 安全性制約の撤廃:Anthropicが設けているAI使用制限(Acceptable Use Policy)の軍への適用除外

これらの要求は、Anthropicが創業以来掲げてきた「AI安全性」の原則と真正面から衝突するものでした。

図1: 米国防総省がAnthropicに要求した3つの条件

Anthropicの拒否

2月27日、AnthropicのダリオCEOは公式声明を発表し、国防総省の要求を正式に拒否しました。

「私たちは、AIが人類に利益をもたらすよう安全に開発されることを使命として創業しました。大規模監視や完全自律型兵器へのAI転用は、この使命に反するものです。私たちはこの原則を曲げるつもりはありません。」

Anthropicは、軍からの契約解除や国防生産法(Defense Production Act)の発動による強制供給の警告を受けても姿勢を崩しませんでした。

トランプ大統領の介入

Anthropicの拒否声明から数時間後、トランプ大統領はTruth Socialで以下の投稿を行いました:

「Anthropicは極左の意識高い系企業(woke company)だ。彼らはペンタゴンを『強引に押し込む』(strong-arm)しようとした。我々はAnthropicを必要としない、望んでもいない、二度と取引しない。連邦政府機関は直ちにAnthropic製品の使用を停止せよ。」

翌28日、ヘグゼス国防長官はAnthropicを「サプライチェーンリスク」に指定する指示を出しました。この制度は通常、外国企業(特に中国系企業)に適用されるもので、米国企業への適用は史上初となります。

業界の反応

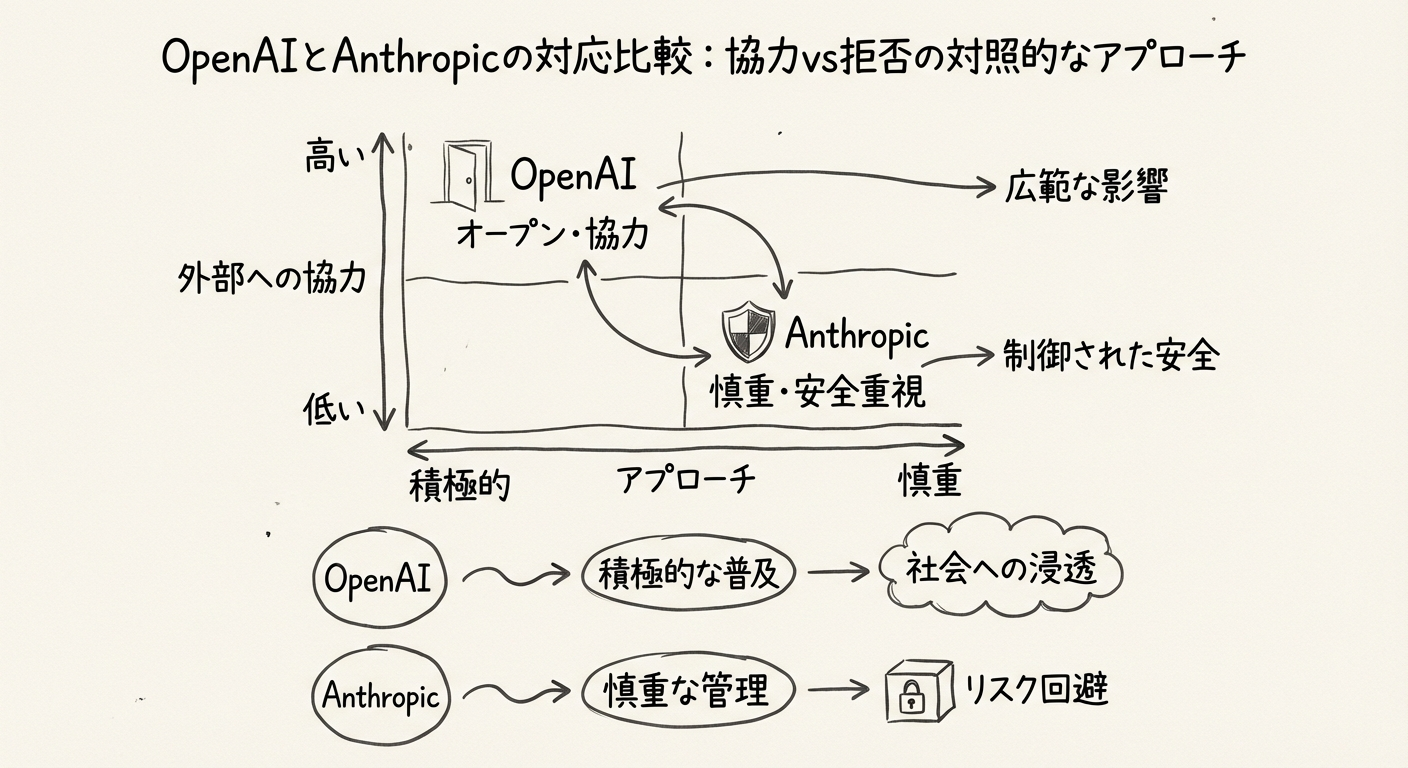

OpenAIの対照的な対応

Anthropicの排除が発表された同日、OpenAIのサム・アルトマンCEOは国防総省との合意を発表しました。

アルトマンCEOによると、OpenAIの契約には以下の「技術的セーフガード」が含まれています:

- クラウド限定運用:AIモデルはクラウド上でのみ実行され、オフライン環境への持ち出しを禁止

- 使用目的の制限:自律型兵器への直接統合を明示的に禁止

- 監査権限:OpenAIが軍のAI使用状況を監査できる条項

「確かに、このディールは急いで進められた。オプティクス(見え方)は良くないかもしれない。しかし、我々は対話の席についたままであることで、より悪い結果を防ぐことができると信じている。」(アルトマンCEO)

図2: OpenAIとAnthropicの国防総省への対応比較

従業員の反応

Google、Amazon、Microsoftの従業員有志は、Anthropic支持を表明する公開書簡を発表しました。

「AI企業が倫理的な境界線を設けることは、長期的には業界全体の信頼性を高めます。Anthropicの決断を支持します。」

一方で、「政府との対立は、AI規制の強化を招きかねない」と懸念する声もあり、業界内でも意見は分かれています。

Anthropicの法的反撃

Anthropicは2月28日夜、「サプライチェーンリスク」指定に対し法廷で争う姿勢を表明しました。同社の法務責任者は以下のように述べています:

「この指定は法的に根拠がありません。サプライチェーンリスク制度は、外国の敵対勢力と関連する企業を対象としたものであり、米国企業に適用することは制度の目的を逸脱しています。我々は連邦裁判所でこの決定の無効を求めます。」

何が本当に問題なのか

AI安全性 vs 国家安全保障

今回の対立の本質は、「AI安全性」と「国家安全保障」のどちらを優先するかという問いです。

Anthropicの立場:

- AI安全性は人類全体の利益に関わる問題

- 一度作られた自律型兵器AIは、他国にも拡散するリスクがある

- 短期的な軍事優位性より、長期的なAI安全性を優先すべき

国防総省の立場:

- 米国は中国・ロシアとのAI軍事競争に直面している

- 民間AI企業が軍の要求を拒否する権限を持つべきではない

- 国家安全保障は企業の倫理方針より優先される

「レッドライン」の設定

Anthropicは明確な「レッドライン」(越えてはならない一線)を設定していました:

- 完全自律型致死兵器:人間の承認なしに殺傷判断を行うAIシステム

- 無差別大量監視:市民を無差別に監視するシステム

- 認知操作:世論操作や洗脳に使用されるAIシステム

一方、OpenAIはこれらの「レッドライン」を明示的に設定せず、「ケースバイケースで判断する」という姿勢を取っています。

業界への影響

AI企業の二極化

今回の事件により、AI企業は大きく2つのグループに分かれつつあります:

「協力派」:政府との対話を維持し、条件付きで軍事利用を認める

- OpenAI

- Google(一定の条件下で)

- Palantir

- Scale AI

「原則派」:AI安全性の原則を堅持し、軍事利用に制限を設ける

- Anthropic

- 一部のオープンソースコミュニティ

投資家への影響

Anthropicの排除は、同社への投資家に動揺を与えています。Googleは約10億ドル、Amazonは最大40億ドルをAnthropicに投資しており、政府契約の喪失が事業価値に与える影響が懸念されています。

一方で、「AI安全性へのコミットメントを示したことで、長期的な信頼性が高まった」と評価する投資家もいます。

規制議論への影響

この事件は、AI規制の議論にも影響を与えています。

規制強化派の主張:

- 政府と企業の対立を防ぐため、AIの軍事利用に関する明確な法的枠組みが必要

- AI企業の自主規制だけでは限界がある

規制慎重派の主張:

- 今回の事件は、企業の自主的な安全性コミットメントが機能することを示した

- 過度な規制はイノベーションを阻害する

日本企業への示唆

AI調達戦略の見直し

今回の事件は、特定のAIベンダーへの依存リスクを浮き彫りにしました。日本企業が取るべきアクションは以下の通りです:

- マルチベンダー戦略の検討:Anthropic Claude、OpenAI GPT、Google Geminiなど複数のAIモデルを使い分ける体制の構築

- オンプレミス対応の検討:クラウドAPIだけでなく、オンプレミスで動作するオープンソースモデルの導入検討

- 契約条項の見直し:AIベンダーとの契約において、政府規制による供給停止リスクに対する条項の確認

コンプライアンス体制の強化

AI利用に関するコンプライアンス体制の強化も重要です:

- AI使用ポリシーの明文化

- サプライチェーンリスクの定期的な評価

- AI倫理委員会の設置(大企業の場合)

長期的な視点

短期的には混乱が続く可能性がありますが、長期的には以下の傾向が予想されます:

- AI企業の「安全性へのコミットメント」が差別化要因になる

- 政府とAI企業の関係に関する法的枠組みの整備

- 国際的なAIガバナンス基準の策定

今後の展望

法廷闘争の行方

Anthropicの法廷闘争は数ヶ月から数年かかる可能性があります。結果によっては、AI企業と政府の関係を規定する重要な判例となるでしょう。

他国への波及

米国でのこの対立は、他国にも影響を与えています。EU、英国、日本などの政府は、自国でのAI軍事利用に関するガイドライン策定を加速させています。

業界の自主規制

今回の事件を受け、AI業界全体での自主規制の動きが加速する可能性があります。複数のAI企業が共同で「軍事利用に関するガイドライン」を策定する動きも報じられています。

AI COMMONでは、AIガバナンスとリスク管理に関するコンサルティングを提供しています。 AIベンダーの選定、マルチベンダー戦略の構築、AI使用ポリシーの策定など、企業のAI活用におけるリスク管理をサポートします。

関連記事

- 週間AIニュース(2026年02月23日週) - 今週のAI業界動向まとめ

- 2026年AIガバナンス:責任あるAI開発とグローバル規制への対応戦略 - AI規制の最新動向

- 週間AIニュース(2026年02月09日週) - EU AI Act施行の影響

参考文献

- TechCrunch「Anthropic vs. the Pentagon: What's actually at stake?」(2026年2月27日)

- Wired「Trump Moves to Ban Anthropic From the US Government」(2026年2月27日)

- The Verge「Defense secretary Pete Hegseth designates Anthropic a supply chain risk」(2026年2月28日)

- VentureBeat「Anthropic vs. The Pentagon: what enterprises should do」(2026年2月28日)

- ITmedia AI+「トランプ大統領、Anthropicを『極左の意識高い系企業』と非難」(2026年2月28日)